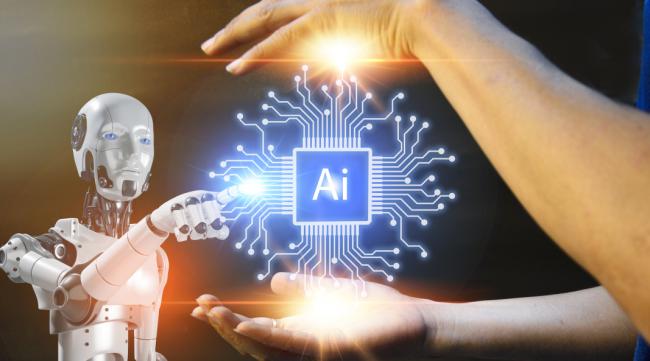

2020年是不寻常的一年,全球的健康、贸易、经济、文化、政治和科技领域,无不发生着深刻的变化。笔者所在的科技领域,也恰逢现代人工智能(简称AI)发展10周年。前10年,人工智能技术得到了长足的发展,但也留下许多问题有待解决。那么,未来AI技术将会如何发展呢?本文将结合学术界、工业界的研究成果,以及笔者个人研究见解,从算力、数据、算法、工程化4个维度,与读者一起探索和展望AI发展的未来。

一

数据

我们首先分析数据的发展趋势。数据对人工智能,犹如食材对美味菜肴,过去10年,数据的获取无论是数量,还是质量,又或者是数据的种类,均增长显著,支撑着AI技术的发展。未来,数据层面的发展会有哪些趋势呢,我们来看一组分析数据。

首先,世界互联网用户的基数已达到十亿量级,随着物联网、5G技术的进一步发展,会带来更多数据源和传输层面的能力提升,因此可以预见的是,数据的总量将继续快速发展,且增速加快。参考IDC的数据报告(图1),数据总量预计将从2018年的33ZB(1ZB=106GB),增长到2025年的175ZB。

通过以上数据维度的分析与预测,我们可以得到的判断是,数据量本身不会限制AI技术,但是人工标注的成本与规模很可能成为限制AI技术发展的因素,这将倒逼AI技术从算法和技术本身有所突破,有效解决对数据特别是人工标注数据的依赖。

二

算力

我们再来看看算力。算力对于AI技术,如同厨房灶台对于美味佳肴一样,本质是一种基础设施的支撑。

算力指的是实现AI系统所需要的硬件计算能力。半导体计算类芯片的发展是AI算力的根本源动力,好消息是,虽然半导体行业发展有起有落,并一直伴随着是否可持续性的怀疑,但是半导体行业著名的“摩尔定律”已经经受住了120年考验(图5),相信未来5-10年依然能够平稳发展。

当然,半导体晶体管数量反映整体趋势可以,但还不够准确地反映算力发展情况。对于AI系统来说,浮点运算和内存是更直接的算力指标,下面具体对比一下GPU和CPU这2方面的性能,如图7所示。可以看出,GPU无论是在计算能力还是在内存访问速度上,近10年发展远超CPU,很好的填补了CPU的性能发展瓶颈问题。

1. 根据OpenAI最新的测算,训练一个大型AI模型的算力,从2012年开始计算已经翻了30万倍,即年平均增长11.5倍,而算力的硬件增长速率,即摩尔定律,只达到年平均增速1.4倍;另一方面,算法效率的进步,年平均节省约1.7倍的算力。这意味着,随着我们继续追求算法性能的不断提升,每年平均有约8.5倍的算力赤字,令人担忧。一个实际的例子为今年最新发布的自然语义预训练模型GPT-3,仅训练成本已达到约1300万美元,这种方式是否可持续,值得我们思考。

2. MIT最新研究表明,对于一个过参数化(即参数数量比训练数据样本多)的AI模型,满足一个理论上限公式:

总结来说,AI工程化正在形成从用户端到云端的,以Python为编程语言的一整套工具链,其3个重要的特点为:远程编程与调试,深度学习与机器学习的GPU加速支持,以及模型训练与推理工具链的解耦。与此同时,产业链上游厂商对开源社区的大量投入,将为中下游企业和个人带来工具链的技术红利,降低其研发门槛和成本,笔者认为微软、脸书、英伟达3家上游厂商主推的开源工具链尤其值得关注。

五

结语

对于人工智能技术过去10年发展取得的成就,有人归因于数据,也有人归因于算力。未来人工智能技术发展,笔者大胆预测,算法将是核心驱动力。同时,算法研发的实际效率,除了算法结构本身,还取决于设计者对先进工具链的掌握程度。

未来10年,科技界是否能用更少的数据,更经济的算力,获得真正意义上的通用智能呢?我们拭目以待。